项目背景

2015年10月,一个概念项目立项——陪伴机器人。我们经过调研和分析,随着消费水平和技术水平提升,智能生态圈可以延展更多可能性,如家庭智能生态圈。

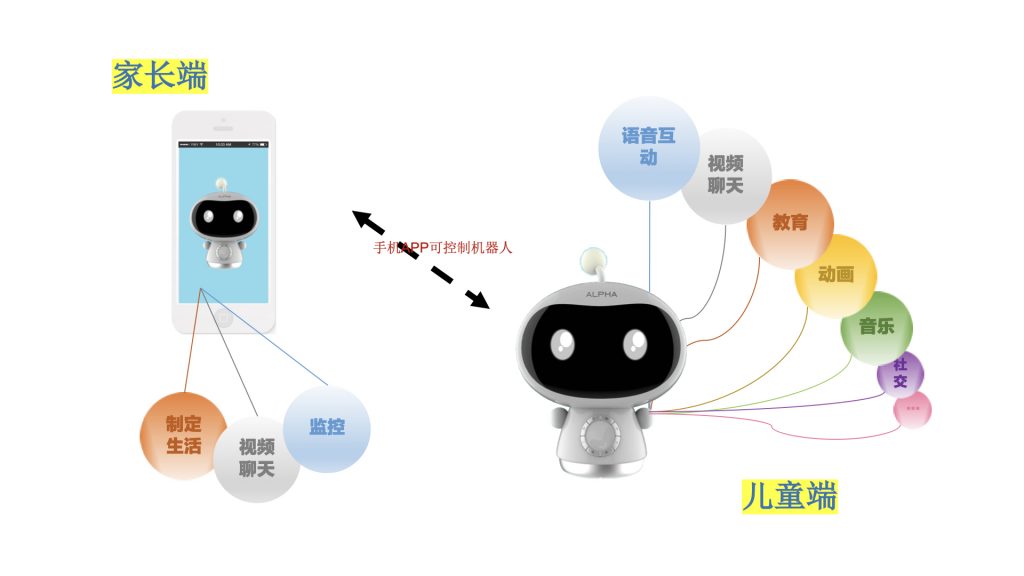

家长和儿童之间可以存在“第三者”——“机器人”,三者共同陪伴,促进家庭关心的新发展。

最终结果

2015年10月立项开始,经过接近三个月不眠不休,在2016年1月12日,向市场展示新产品「陪伴机器人」

项目过程

「陪伴机器人」服务于儿童(3-12岁)用户和家长用户。

小朋友可以可以和机器人有以下互动:

- 和机器人语音聊天

- 通过机器人和父母视频聊天

- 机器人内有海量的教育、动画、音乐资源

- 小朋友的小伙伴们也拥有机器人的话,各个机器人可以相互加朋友,然后通过机器人互相聊天

- ……

家长可以和机器人有以下互动:

- 通过机器人了解孩子目前的状态

- 通过机器人和孩子视频聊天

- 通过机器人帮孩子设定符合想法的场景,例如:希望晚上10点让机器人陪伴孩子睡觉,制定指令让机器人晚上10点为孩子朗诵安徒生童话故事。

有趣的难点

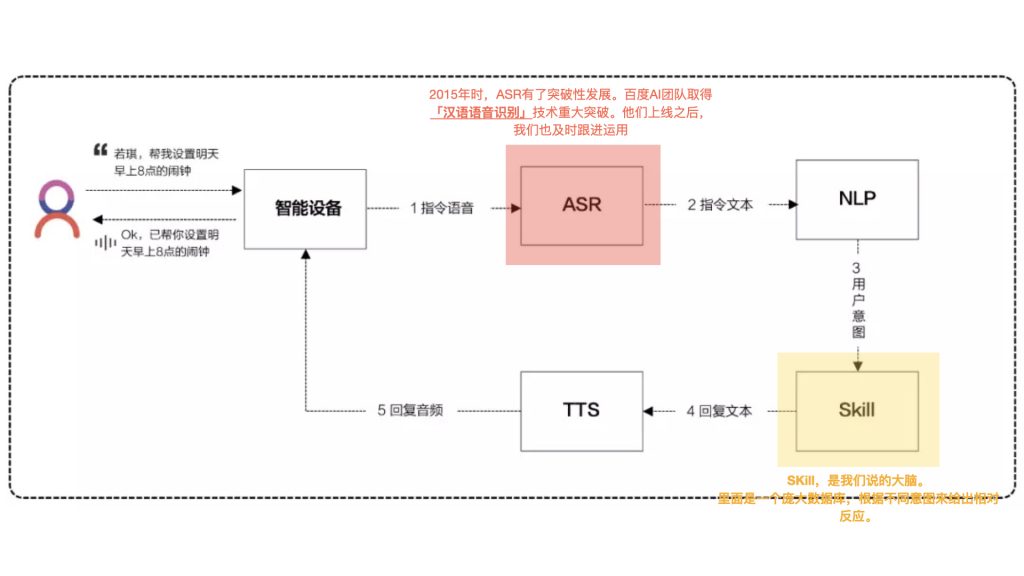

2015年,语音技术并没有发展得比较成熟。我们需要自行组装整个语音模块,利用各大厂提供的技术接口,串联起我们的语音聊天线。

(1)ASR(Automatic Speech Recognition,语音识别)

用于将声学语音进行分析,并得到对应的文字或拼音信息。语音识别系统一般分训练和解码两阶段:

- 训练即通过大量标注的语音数据训练数学模型,通过大量标注的文本数据训练语言模型;

- 解码,即通过声学和语言模型将语音数据识别成文字。

声学模型可以理解为是对发生的建模,它能够把语音输入转换成声学表示的输入,更准确的说是给出语音属于某个声学符号的概率。语言模型的作用可以简单理解为消解多音字问题,在声学模型给出发音序列之后,从候选的文字序列中找出概率最大的字符串序列。

/*

2015年,最大困难在于,当时开放的ASR接口尚未有「汉语普通话」的语音识别免费的技术,可是后来百度AI团队突破这个难关,将技术接口公开,为我们这里的设计解决一大难题。

*/

(2)NLP(Natural Language Processing 自然语言处理)

用于将用户的指令转换为结构化的、机器可以理解的语言。

NLP的工作逻辑是:

将用户的指令进行Domain(领域)→Intent(意图)→Slot(词槽)三级拆分。

以“帮我设置一个明天早上8点的闹钟”为例:该指令命中的领域是“闹钟”,意图是“新建闹钟”,词槽是“明天8点”。这样,就将用户的意图拆分成机器可以处理的语言。

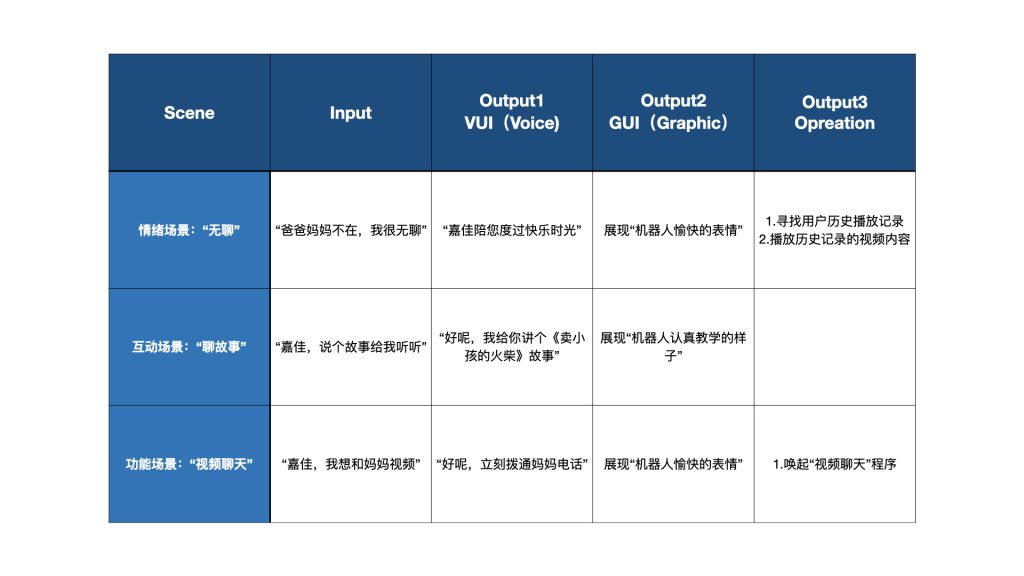

(3)Skill(技能,我们也称大脑处理器)

也即AI时代的APP。Skill的作用就是:处理NLP界定的用户意图,做出符合用户预期的反馈。

/*

2015年,我们遇到最大的困难是「大脑」的自定义。鉴于我们做的内容是儿童用户为主要目标用户,因此「大脑」里需要有对于儿童用户的认知和反馈。可是当时技术有限,市场上并没有合适的系统,我们几乎是自建。

以下是我们一表格,Input(语音或按键);Output(语音、界面、视频或者机器人的设备如闪灯)

我们需要自定义这样的「大脑」,让嘉佳更贴合小朋友的需求。

同时,我们也将这个训练系统放到家长端,可以让家长定制生活。

*/

(4)TTS

即语音合成,从文本转换成语音,让机器说话。TTS业内普遍使用两种做法:一种是拼接法,一种是参数法。

- 拼接法即从事先录制的大量语音中,选择所需的基本发音单位拼接而成。优点是语音的自然度很好,缺点是成本太高,费用成本要上百万。参

- 数法指使用统计模型来产生语音参数并转化成波形。优点是成本低,一般价格在20万~60万不等,缺点是发音的自然度没有拼接法好。但是随着模型的不断优化,现在参数法的效果已经非常好了,因此业内使用参数法的越来越多。

结语

项目推出,希望让孩子和家长的交流陪伴上多一种可能性。也从陪伴机器人方切入到家庭生态圈里,让家长和孩子之间的关系更上一层楼。